Mes plus fidèles lecteurs – et, Dieu sait qu’il y en a – vont penser que je fais une sorte de fixation sur le théâtre moyen-oriental. Je m’en défends. D’ailleurs je viens de regarder Gasland.

Le changement c’est maintenant

Le récent atterrissage d’Edward Snowden à Moscou a alimenté les spéculations sur sa prochaine destination. Mais le contexte global de l’affaire n’est jamais évoqué. Assumant une mission de service public d’information, votre serviteur prend de son temps pour vous expliquer ce qui est réellement en jeu.

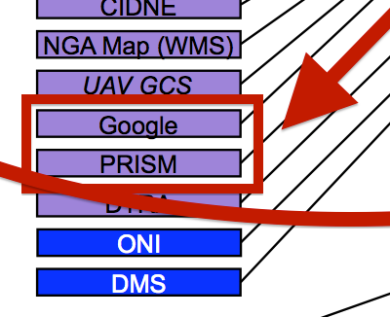

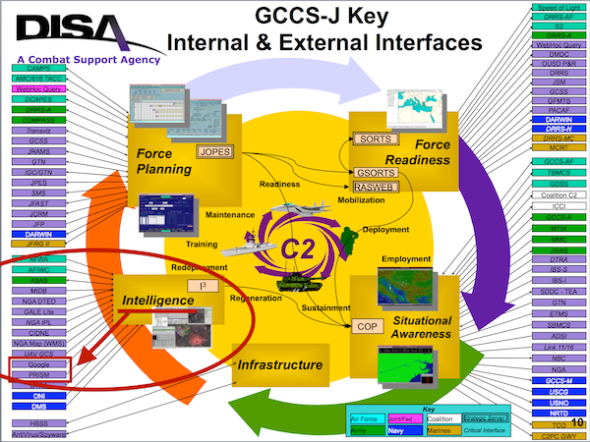

Pourquoi les Etats-Unis cherchent-ils à extrader M. Snowden ? Ce consultant en sécurité IT à la NSA a dévoilé l’existence d’un système automatisé de stockage et de traitement de l’information, connu sous le nom de PRISM. Le scandale est-il à la hauteur de l’info ? Non : PRISM n’est en effet que la face visible de la partie émergée de l’iceberg « surveillance globale des communications » américain. On se réfèrera pour plus de précisions à l’excellent article de Kitetoa sur Reflets.info, où on visualise la place de ce « Planning Tool for Resource, Integration, Synchronization, and Management » dans le dispositif :

Ce que Kitetoa a appelé la « Big picture », c’est l’ensemble de ce système stratégique global, visible sur la première image. Alors, on sait depuis longtemps que les Etats-Unis sont le flic du monde. Julian Assange ou Bradley Manning sont au courant. Même s’il leur arrive de se prendre les pieds dans le tapis quand vient le moment de transcrire en droit international des opérations du type de celle qui a permis l’interpellation de Kim Dotcom, en général, quand Washington a un objectif, les choses se font. Seulement c’est moins facile depuis quelque temps.

Quand à la fin de la guerre froide, la superpuissance s’est retrouvée seule aux commandes, il y a eu quelques cafouillages, mais en gros, tout le monde fermait sa gueule. Il a fallu les attentats du 11 septembre 2001 pour qu’on se rende compte que le colosse pouvait aussi avoir des soucis. Depuis cette remise en question de l’autorité américaine, les rouages grincent de plus en plus. Si tous ont suivi l’OTAN en Afghanistan, l’expédition irakienne n’a pas fait l’unanimité (on pourrait une fois de plus rappeler ce « non » splendide de Villepin à l’Assemblée Générale de l’ONU en 2003, mais ça ferait chauvin).

C’est que l’opération visant à réduire Saddam Hussein sentait fort le pétrole. Tellement fort en fait que les mauvaises langues ont chuchoté que la guerre pour l’énergie avait commencé. L’Iran, dans le collimateur depuis Bush père, devait être la prochaine conquête sur la liste. Sauf que si les Américains ont déjà plein d’alliés dans le secteur (Turquie, Jordanie et, last but not least, Israël), il leur restait un caillou dans la rangers : la Syrie. Bachar Al-Assad, dentiste éduqué en Angleterre, ne voulait pas le pouvoir à la base. Mais à la mort de son père, il est propulsé à la tête de l’Etat. Et on a beau être un président contraint, on peut ne pas apprécier que des mercenaires formés en Jordanie par la CIA viennent prétendre au contrôle de votre pays.

Bachar se trouve un allié de poids en la personne de Vladimir Poutine. Lui est président de la Russie depuis une vingtaine d’années. Bon, il a dû passer la main à son poteau Medvedev pour pouvoir modifier la Constitution russe et faire plus de deux mandats, m’enfin il n’a jamais été très éloigné du Kremlin. Il se trouve que la Russie est géographiquement proche de l’Iran, et même de la Syrie. Et pour Vladimir, avoir tout plein de bases américaines à côté de chez lui, ça lui paraît être une mauvaise idée. Laisser le contrôle de l’Asie Centrale à Barack, ça l’ennuie. Alors il utilise tous les moyens à sa disposition pour soutenir Bachar, les moyens légaux (veto à l’ONU), et les autres.

Oui, il est illégal aux termes du droit international de vendre ou de fournir des armes à un pays en état de guerre civile. La France semble ne pas le savoir, mais les Allemands, eux, sont au courant. C’est d’ailleurs pour ça qu’ils refusent de fournir une aide militaire, même sous forme de matériel, à l’une des deux faction en présence. Et le fait que l’Allemagne dépend en grande partie du gaz russe pour son approvisionnement énergétique doit l’aider à avoir envie de respecter le droit international.

Tout ça va de pair avec la prise d’influence croissante des BRICS sur les marchés internationaux : le Brésil dans l’agriculture, la Russie sur le plan de l’énergie, l’Inde dans l’industrie de production, la Chine dans les productions high-tech, l’Afrique du Sud dans les métaux précieux. Dans ce contexte, que reste-t-il aux Américains ? La haute technologie (cf. supra), et le Big Gun. Tous deux sont utilisés à des fins stratégiques, pour conserver le leadership global.

De fait, nous vivons dans un monde multipolaire. Mais l’Asie concentre les ressources démographiques, industrielles et énergétiques. Il y a fort à parier que dans les vingt prochaines années (et même en cas d’effondrement économique global), le centre de gravité du monde ne se déplace vers l’Est. Ce pied de nez récent de Poutine « Snowden a ‘free man’ in Moscow airport, Russian president says » n’est qu’une manifestation de ce transfert de pouvoir. La guerre civile en Syrie en est une autre manifestation.